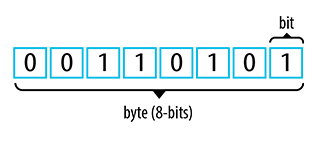

La información que se almacena en una computadora o dispositivo digital está cuantificada en una unidad de medida llamada bit.

Un bit se abrevia con la letra b, haciendo referencia al código binario compuesto por cadenas de números 1 y 0. Un bit correspondería a un 1 o un 0 de una secuencia binaria.

Para representar letras, caracteres o números, las computadoras utilizan códigos que se basan en series de bits, como el código ASCII, EBCDIC y Unicode.

• ASCII en su versión extendida utiliza ocho bits para representar los caracteres que incluyen recuadros, flechas, círculos y otros símbolos.

• EBCDIC empleaba ocho bits y era usado principalmente en mainframes antiguos de IBM.

• Unicode usa 16 bits y proporciona código para 65 000 caracteres que abarcan varios idiomas.

Código binario